湖南省高速公路“视频联网管理体系 + 视觉大模型事件检测”双轮驱动创新方案报告

一、背景

在国家大力推进交通基础设施数字化转型的战略背景下,湖南省高速公路通车里程已突破7000公里,路网涵盖大量隧道、桥梁、长下坡等复杂路段,日均车流量持续攀升。在此背景下,传统管理模式面临两大核心挑战:

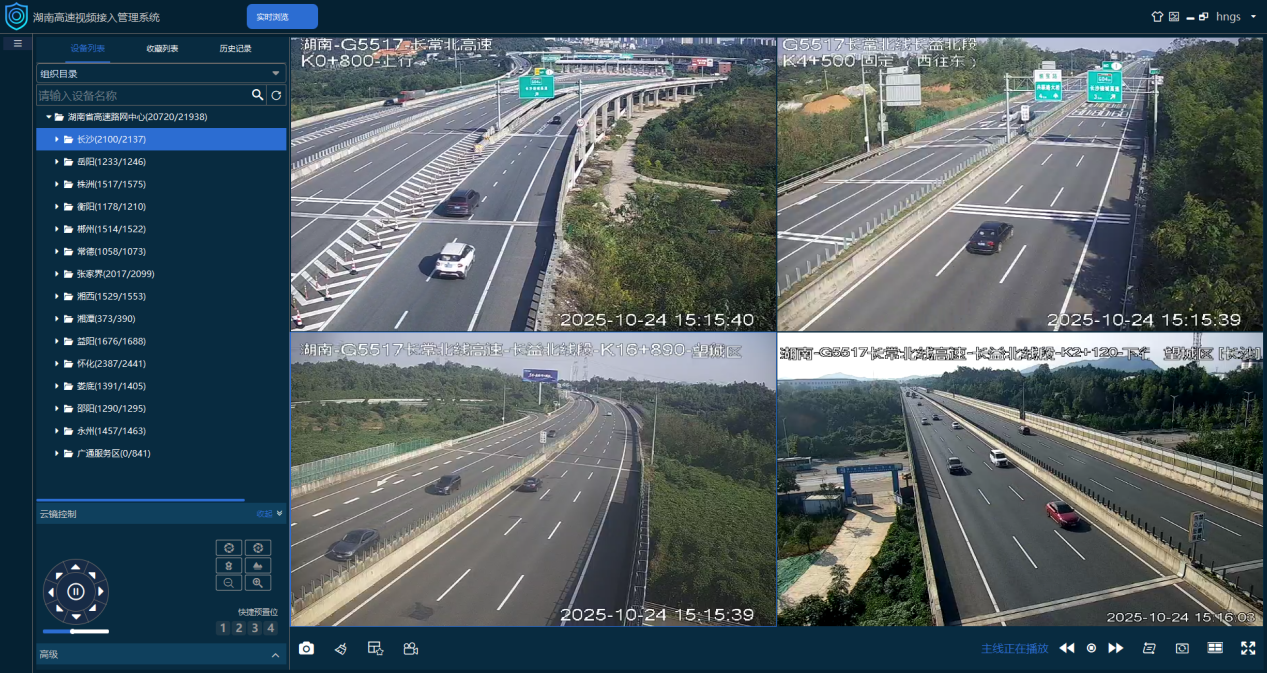

1.视频系统“碎片化”难题凸显:省中心与各区域分中心平台协同效率低,视频资源难以跨域共享与统一调阅,存在调取卡顿、共享壁垒等问题。全量视频接入能力与精细化运维手段缺失,难以形成统一的视频资源池支撑全省业务。

2.事件检测智能化水平严重不足:海量视频监控主要依赖人工轮巡盯屏与传统的计算机视觉算法,不仅人力成本高,且在暴雨、团雾、夜间等复杂环境下,传统算法误报率与漏报率居高不下,导致事件发现滞后、响应迟缓,对路网运行安全与效率构成严重威胁。

二、目标

本创新方案的总体目标是,通过“视频联网”与“AI智能”的深度融合,从根本上破解既有痛点,具体设定为:

实现视频全域覆盖与高效治理:建成全省“一张网”视频联网体系,消除接入盲区,实现视频资源从“分散孤立”到“统一汇聚、按需共享”的转变,支撑高并发、低延迟的跨域调阅。

实现事件精准感知与智能预警:构建高精度、高鲁棒性的事件智能检测体系,关键事件检测准确率显著超越传统方案,尤其在恶劣天气下保持稳定性能,实现从“人找事件”到“事件找人”的转变。

实现业务高效协同与闭环处置:打通跨部门(交警、养护等)的数据共享与业务联动通道,形成“智能检测-实时告警-协同处置-反馈优化”的分钟级应急响应闭环,大幅提升路网安全保障与通行效率。

三、建设内容

围绕上述目标,方案从两大核心维度系统性地展开建设:

(一)构建全链路、高性能的视频联网管理体系

o创新的四级组网架构:

o采用“双网并行、级联互通”的顶层设计。路网视频监控网负责汇聚整合全省主线、隧道、服务区、桥梁等路网视频资源(含自管及BOT方),通过GB28181协议级联至省中心,平台设计支持50000路4M码流处理能力。收费视频专网物理隔离,由分中心建设国标平台(集群部署,智能存储≥90天),

直连收费站前端,再经安全边界与路网平台级联,实现收费视频按需共享。

o全量与全协议接入能力:

o实现主线、隧道、收费站广场、服务区、桥梁、应急仓库、边坡监测等8大

类场景视频“应接尽接”,单条100公里路段接入摄像机超180路。

o协议全兼容,支持GB/T28181-2022(平台级联)、RTSP/Onvif(前端直连)SDK(第三方设备)等多种方式,充分利旧。为满足视频上云考核,在分中心部署上云网关,采用“低码流实时推送+高码流按需调用”模式,有效节约带宽,保障部级与内网双图像在线率稳定在95%以上。

o精细化运维与全生命周期管控:

o基础数据与权限管理:构建了统一的视频基础数据库,实行“分权分域”机制,设置5级以上用户权限,按组织目录与设备列表精准授权,严防越权。

o特情管控与智能预警:支持针对警卫等特情一键关闭指定视频,防止外泄。实时监测设备在线率与组件性能,支持客户端弹窗与语音告警,设备离线提醒间隔可自定义,故障排查效率提升40%。

o运维可视化:省中心通过定制化“综合态势”页面一屏统揽全省设备状态,分中心平台精准统计离线时长与故障分布,支撑精准决策。

o安全高效的多维度共享机制:

o提供Web端、CS客户端、国标对接(GB28181)、SDK/Restful接口等4种共享形式,适配各类业务系统与终端,跨平台共享延迟≤1秒。

o共享权限精细化,可按需向第三方单位(如交警、养护部门)提供全量、组织目录或单设备等不同粒度的共享,并精准控制其实时浏览、回放或云台控制权限,确保数据安全可控。

(二)实现技术突破的AI视觉大模型事件检测

o高效的四阶段流水线架构:

o数据预处理:自适应抽帧(拥堵1秒/帧,畅通5秒/帧),使单路视频日均数据量从15GB降至1.08GB;采用强光抑制、高斯滤波优化图像,车辆轮廓清晰度提升40%。

o前置检测:采用优化的YOLOv8-light模型,一次性识别车辆、行人、抛洒物等12类目标,定位误差≤5像素,过滤90%静态背景帧,有效分析帧占比提升至85%。

o特征提取:基于ViT-L/16 Transformer架构,融合视觉特征、路网数据与环

o境数据,构建768维特征向量,逆行检测准确率较传统CNN提升18%,并支持一次特征提取完成7类事件检测。

o语义分类:针对每类事件开发专用轻量微模型,采用LoRA技术(冻结98%预训练参数),仅需300张样本即可实现92%准确率,新增场景开发周期从1-2个月缩短至1-2天。最终输出结构化结果,告警延迟≤3秒。

o全维度数据支撑与训练优化:

o多源数据采集:汇集湖南省2022-2024年事件录像、Waymo等公开数据集及模拟数据,总样本量超200万帧,全面覆盖各种天气与光照条件。

o分级存储与数据增强:采用“内存-SSD-HDD”三级存储架构降低成本;通过清洗空帧、模糊帧及添加雨雾特效等增强手段,小样本事件(如抛洒物)样本量提升40%,增强了模型鲁棒性。

o高效训练与场景适配:采用分布式训练(6张GPU下,105万帧训练集迭代时间从24小时缩至6小时)、LoRA微调、改进Focal Loss与CIoU Loss等技术,使模型平均准确率达到93.8%,误报率3.2%。并针对主线、隧道、施工区等不同场景定制适配器,确保在暴雨、团雾等复杂环境下准确率≥85%。

o完整的业务应用闭环:

o告警信息通过GB28181协议实时对接视频共享平台,并推送至交警、养护等部门移动端。处置结果可回传用于模型优化,形成“检测-告警-处置-反馈”的数据驱动闭环,从根本上了提升处置效率。

四、实施效果

(一)视频联网管理效能实现跨越式提升

1.接入覆盖无盲区:实现了全省8类场景视频全量接入,分中心平均接入了3000+路视频,省中心支持3000路4M码流并发调阅,首屏加载时间<2秒,卡顿率从30%降至5%以下。

2.运维成本显著降低:通过智能预警与可视化运维,故障排查时间从2小时缩至30分钟;分级存储与智能抽帧技术使100公里路段年度存储成本降低40%,省、分中心两级运维人力需求减少50%。

3.跨域共享效率倍增:4种共享形式使第三方系统对接接口开发周期从2-3周缩短至1-2天。截至2025年,已与省路网运行监测平台、交警应急指挥系统等12个平台实现

数据互通,跨部门视频调用响应时间≤1秒。

(二)AI事件检测性能领跑行业

1.检测精度实现质的飞跃:7类核心事件平均准确率从传统CNN68.6%提升至93.8%,

2.误报率从31.7%降至3.2%。其中,抛洒物识别准确率92.5%,行人闯入94.3%,复杂环境下准确率≥85%,漏报率≤1.2%。

3.处置效率与安全效益倍增:事件的平均处置时间从40-70分钟缩短至15-25分钟,效率提升160%-280%。以G4京港澳高速抛洒物事件为例,从发现到处置完毕仅用18分钟,较传统模式效率提升150%,二次事故发生率降低35%。

4.全生命周期成本大幅优化:以100公里高速公路5年周期计算,总体成本节约65.5%

其中硬件采购成本降37.8%,人工标注成本降93.3%,模型迭代成本降96.4%。

(三)路网运营与安全水平全面升级

1.通行效率显著提升:通过快速事件处置与高精度拥堵预测(误差≤500米),路网整体通行效率提升18.3%,单次拥堵平均时长从2小时缩至45分钟,年均节约司乘出行时间超100万小时。

2.政策引领与标杆示范:提前达成《路网运行监测预警与应急指挥调度试点工作要求》中“2025年前重点路段事件检测全覆盖”目标,为省级乃至全国交通数字化转型提供了成功的实践案例。

3.安全效益空前显著:二次事故发生率从35%降至12%,隧道内夜间事件漏报率从55%大幅降至0.8%。2025年试点路段未发生因事件处置不及时导致重大交通事故,安全管理迈上新台阶。

完成单位:南京奥看信息科技有限公司

完成人:龚啸、邵泽峰、罗陵、刘春成、钟标