虚拟人治理:可信与合规

ChatGPT爆重大漏洞,AI安全引人震惊。

3月25日,OpenAI官方发布了3月20日ChatGPT临时中断服务的调查报告,并表示有1.2%的ChatGPT Plus用户可能数据被泄露。

“我们在本周一关闭ChatGPT几个小时前,部分用户可能会看到另一位活跃成员的姓名、电子邮件地址、支付地址、信用卡的后四位和信用卡到期时间。我们承诺在任何情况下,都不会暴露完整的信用卡号码”。

OpenAI表示,已联系到所有可能受到影响的用户,同时向用户和整个ChatGPT社区致歉。

据媒体报道,ChatGPT之父对AI技术的高速发展充满担忧,认为社会各界及监管机构应该共同参与ChatGPT技术的测试。

虚拟人产业的风险合规问题

ChatGPT持续爆火,人们的关注点逐渐转移,开始关注它能带来哪些产业的突破性进展。虚拟人就是其中之一。

《虚拟数字人深度产业报告》预计,到2030年我国虚拟数字人整体市场规模将达到2703亿元。其中,“身份型虚拟人”市场规模预计达到1740亿元,占主导地位,而“服务型虚拟人”总规模将超过950亿元。

近年来,作为元宇宙和AIGC的关键产业要素,虚拟人概念炙手可热,技术产业发展乘势而起,呈现强劲的增长态势。但是,快速发展的市场机遇下蕴含着一系列挑战和风险。

首先,随着虚拟人向各行各业渗透,用户对虚拟人生成能力要求将越来越高,是否能够满足用户期待和不同需求成为虚拟人生成系统能力的一大挑战。

其次,对虚拟人的毁誉褒贬和权益侵害可能及于线下真人,对真人造成实际影响和侵害,目前虚拟人的版权等问题在国内外已出现多起法律纠纷;

此外,虚拟人产品涉及内容传播及多项技术的融合应用,在内容安全、隐私保护、数据安全、算法合规、系统可控等诸多方面也可能引发信任危机,带来一系列的伦理和社会问题。

日前,中国信息通信研究院发起《可信虚拟人生成内容管理系统技术要求》标准制定项目,并且正在筹备《可信虚拟人白皮书》,目标直指虚拟人AIGC。

虚拟人治理的本质:治理真人

“虚拟人有很多定义和应用场景,但归根到底虚拟人可以分成两种,有灵魂的和没有灵魂的”。

虚拟人成为怎样一个“人”,这是个运营问题,而非技术问题——在目前以及可预见的将来都是如此。虚拟人的人格是由运营商、用户赋予的,技术只是实现的手段。于是针对虚拟人的治理,主要还是管理虚拟人背后的真人。

目前国内的互联网生态,已经开始处理这一类问题原初版本。比如在2020年,著名主持人何炅将一家技术公司告上法庭,原因是该公司的APP产品为用户提供了定制聊天机器人的服务,于是有用户用何炅的姓名和肖像“调教”出来一个聊天机器人。最终北京互联网法院认定,被告公司的产品不仅侵犯了何炅的肖像权,而且还对原告的人格自由和人格尊严造成潜在负面影响,判决被告赔礼道歉、赔偿损失。

聊天机器人也好,更复杂一些的AI应用也好,涉及到一些用现有逻辑就能解决的法律问题。监管和执法部门只需要把从前给传统媒体和互联网治理画的“红线”稍微再画长一点,就能把AIGC、虚拟人也涵盖进去。

2023年1月10日,国家互联网信息办公室、工业和信息化部、公安部联合发布的《互联网信息服务深度合成管理规定》(以下简称为《规定》)开始实施。该法规的关键词“深度合成”,指的是用深度学习或虚拟现实方法生成数字作品的技术,涵盖AI生成的文字、图像和声音,也包含合成人声、换脸、仿真空间等数字产品——这主要是AI领域在两年前出圈的应用,但也能够将AIGC纳入合规范围。

《规定》中的具体内容主要是从前监管要求的必要延伸。比如,传统上的信息服务,需要保证产品的信息安全属性,不侵犯他人的隐私、肖像权、人格权、知识产权;这些原则现在也按《规定》适用于深度合成的产品或者服务。类似地,《规定》还要求内容平台履行审核义务,保证平台上发布的深度合成作品符合法律法规、不危害国家安全和社会稳定。

《底特律:变人》游戏截图

中国虚拟人产业合规发展建议

经过几年的讨论和积淀,人类对AI的一般伦理要求,通常概括为“负责任AI”或“可信AI”这两个概念。

“负责任”或“可信”的总要求,又可以拆分成几条具体的原则。不同科技公司有不同的拆法,但基本上大同小异。就拿行业先驱微软为例,它把负责任AI归纳为6个原则:公平性、安全与可靠、隐私与数据安全、包容性、透明性、可问责性。

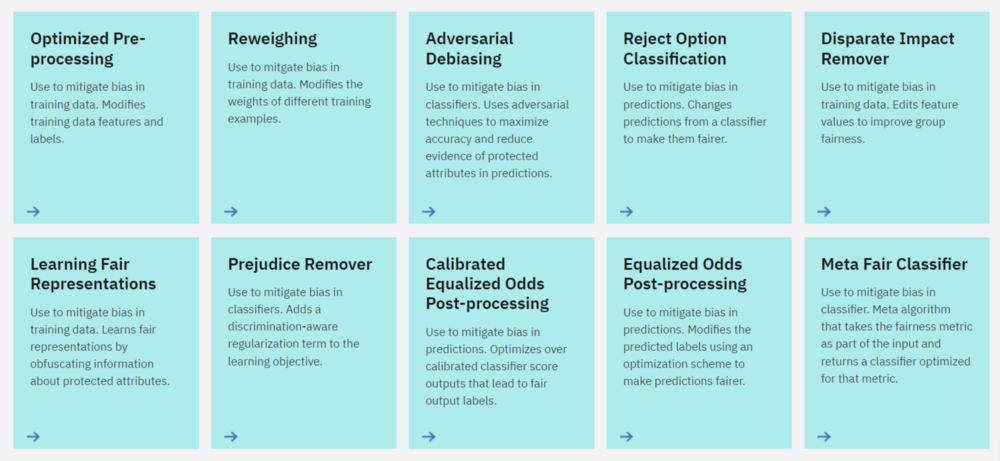

产业链上比较大的技术供应商通常都设有专门的AI伦理部门,他们依据对可信AI的原则拆分,开发出促进公平、安全、透明等特性的技术解决方案,并将方案开源。比如下图是IBM开源出来的一些促进AI公平性的算法。

来源:IBM可信AI官网

没有完美的技术,关键在于如何使用技术。

在技术层面,虚拟人除了解决现有安全挑战之外,还需要在现有硬件能力和算法的基础上继续探索和升级,包括深度合成技术数据安全规范、算法治理和推荐的相关要求、网络音视频信息技术支持的内容安全等。如果涉及到区块链技术,还需要进行区块链安全评估并办理区块链信息服务备案。

提前规划布局,开展审慎、包容监管。

为更好地应对虚拟数字人潜在的风险问题,建议联合产业界各方着重以下两个方面的工作推进。

一是共同开展数字人身份管理及内容安全的研究工作,从政策层面做好产业体系化布局,在坚决打击恶意违法行为的同时,给新兴技术一定包容发展的空间;

二是加紧研究各类虚拟数字人应用对人的心理影响,以及对人类社会带来的影响,并尽快出台相关约束与法律法规。

文章参考:

1.《ChatGPT爆重大漏洞:可能泄露1.2%用户数据,AI安全引人震惊》清元宇宙

2.《虚拟人是坐不了牢,但企业可能替它坐牢》虎嗅APP

3.《虚拟人能否靠ChatGPT迎来巨大突破?》21世纪经济报道

4.《“虚火”之下虚拟人如何适者生存》中国高新技术产业导报